Các tác nhân AI đang tiến nhanh từ những bản demo ấn tượng thành công cụ thật sự có thể thực hiện hành động thay bạn, và OpenClaw là một trong những cái tên thu hút làn sóng chú ý gần đây. Bạn có thể đã nghe phần mềm này với các tên khác như Clawdbot và Moltbot — những tên được tác giả, nhà phát triển người Áo Peter Steinberger, dùng ở các giai đoạn phát triển khác nhau.

Được quảng bá như trợ lý cá nhân không cần can thiệp thủ công, có khả năng vận hành phần mềm thay bạn, OpenClaw cũng đặt ra những câu hỏi quan trọng về quyền truy cập và bảo mật.

- Các tác nhân AI là hệ thống AI có khả năng thực thi hành động, không chỉ là công cụ hội thoại.

- Những công cụ như OpenClaw cho thấy tác nhân AI tự lưu trữ có thể mạnh đến đâu.

- Sức mạnh này đem theo các rủi ro bảo mật mới khi tác nhân xử lý đầu vào không đáng tin cậy.

- Chèn lệnh (prompt injection) là mối đe dọa then chốt với tác nhân AI, còn hơn cả với chatbot.

- Bộ nhớ kéo dài (persistent memory) có thể khuếch đại sai sót và kéo dài cuộc tấn công.

- Các tác nhân AI mạnh mẽ, nhưng không phải lựa chọn an toàn mặc định cho phần lớn người dùng cá nhân.

Tại sao OpenClaw lại gây ra nhiều chú ý?

OpenClaw được chú ý vì nó đại diện cho sự chuyển hướng từ AI chỉ trả lời câu hỏi sang AI có thể chủ động thực hiện nhiệm vụ trên hệ thống thực và thậm chí sử dụng phần mềm. Những vấn đề an ninh tiềm tàng khiến cộng đồng bảo mật cũng nói nhiều hơn về OpenClaw. Điều gì làm OpenClaw hấp dẫn với nhà phát triển và người dùng nâng cao?

OpenClaw nổi bật vì nó có thể thực hiện hành động thực tế, không chỉ tạo ra văn bản hay gợi ý. Thay vì chỉ bảo bạn nên làm gì, nó có thể tự làm các việc đó. Công nghệ này có thể mở ứng dụng, gửi tin nhắn, di chuyển tập tin, chạy lệnh và tương tác trực tiếp với hệ thống thay bạn.

Mức độ tự động hóa đó là điều thu hút sự quan tâm. Nhà phát triển và người dùng cao cấp nhìn thấy quyền điều khiển ở mức hệ thống như cách giảm công việc lặp đi lặp lại hoặc tự động hóa luồng công việc. Ý tưởng về một tác nhân AI có thể “làm việc” thay vì chỉ hỗ trợ từ bên lề là một khái niệm mạnh mẽ.

Cam kết về khả năng thực thi này chính là lý do OpenClaw nhanh chóng được nhắc đến nhiều hơn từ một dự án ngách sang thảo luận rộng rãi.

Tại sao điều này quan trọng vượt ra ngoài OpenClaw

OpenClaw cung cấp một ví dụ dễ thấy về xu hướng rộng hơn hướng tới các tác nhân AI thực sự hành động, không chỉ phản hồi và đưa lời khuyên.

Khi công nghệ như vậy phát triển, các câu hỏi về lạm dụng tiềm tàng trở nên không thể tránh khỏi. OpenClaw cho thấy hướng đi của AI, khiến nó có liên quan vượt ra ngoài một dự án đơn lẻ và đặt nền tảng cho các cuộc tranh luận tiếp theo về cách kiểm soát những tác nhân này. Liệu chúng có thể được tin tưởng?

Tác nhân AI là gì, và điểm khác biệt so với công cụ AI khác là gì?

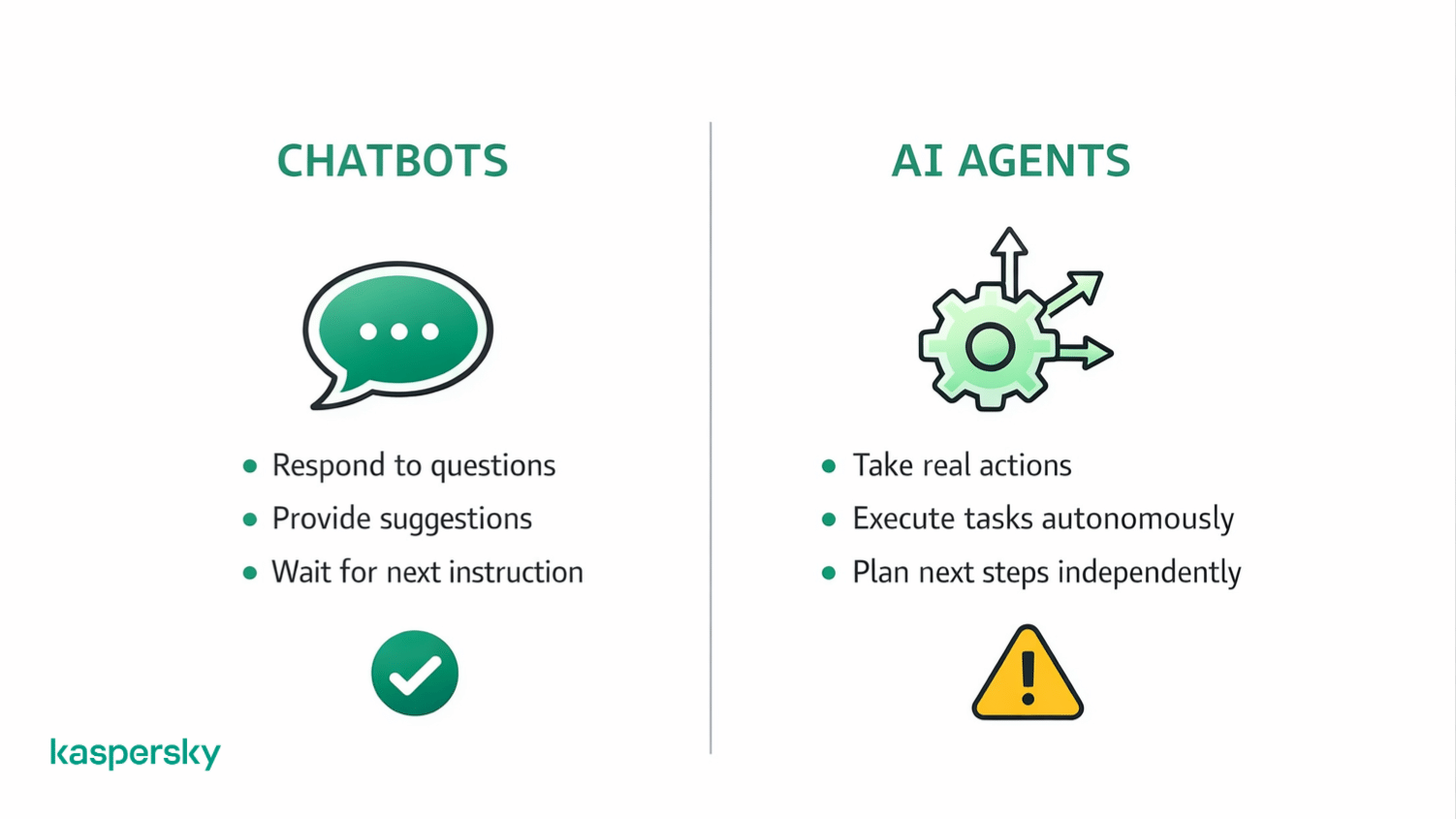

Các tác nhân AI là những hệ thống không chỉ cung cấp câu trả lời dạng văn bản hay âm thanh cho câu hỏi của bạn. Chúng có thể lập kế hoạch các bước và thực hiện hành động để đạt được mục tiêu. Thay vì dừng lại ở khuyến nghị, chúng quyết định bước tiếp theo và thực thi nó.

Một tác nhân AI có thể quan sát một tình huống và đưa ra hành động. Điều này khác với hầu hết công cụ AI hiện nay, vốn phản hồi theo prompt nhưng chờ lệnh tiếp theo. Các ví dụ sớm gồm các tác nhân chạy nhiệm vụ như Manus (hiện thuộc Meta). Manus cho thấy tác nhân có thể vượt ra khỏi chat và thực hiện hành động: phân tích dữ liệu hoặc thậm chí viết mã để giải quyết vấn đề mà không cần được yêu cầu rõ ràng. Ít sự can thiệp của con người hơn.

OpenClaw xây dựng trên cùng ý tưởng đó về AI có khả năng hành động, nhưng áp dụng nó theo cách trực tiếp và mạnh mẽ hơn.

OpenClaw là tác nhân AI điển hình hay vượt trội hơn?

OpenClaw thuộc loại tác nhân AI. Nó là một hiện thực hóa mạnh hơn so với nhiều công cụ mà đa số người dùng hiện nay quen thuộc.

Công cụ AI này có thể lập kế hoạch nhiệm vụ và hành động mà không cần đầu vào liên tục. OpenClaw có thể tương tác trực tiếp với phần mềm và hệ điều hành, không chỉ API hạn chế hay công cụ giới hạn. Quyền truy cập rộng hơn này làm tăng tính hữu ích và tạo sự khác biệt. Đồng thời nó cũng làm tăng rủi ro và tầm quan trọng của bảo mật.

Tại sao tác nhân AI tự lưu trữ khác biệt

Tác nhân AI tự lưu trữ chạy cục bộ trên hệ thống của bạn thay vì trên dịch vụ từ xa. Điều này giúp người dùng kiểm soát hơn về cấu hình và hành vi. Nhưng đồng thời, trách nhiệm cũng chuyển sang người dùng.

Khi một tác nhân có truy cập cục bộ, an ninh phụ thuộc vào cách nó được thiết lập, những quyền nó có, và cách giám sát. Nhiều quyền kiểm soát hơn đồng nghĩa với rủi ro nhiều hơn.

Các dự án gần đây cho thấy ý tưởng “tự lưu trữ” đang bắt đầu thay đổi. Ví dụ, Moltbot (trước đây là Clawdbot) hiện có thể chạy trên Moltworker mã nguồn mở của Cloudflare. Điều này loại bỏ hoàn toàn nhu cầu về phần cứng cục bộ chuyên dụng bằng cách chạy tác nhân trên nền tảng được quản lý thay vào đó.

Điều này giảm rào cản gia nhập và đơn giản hóa việc thiết lập, nhưng cũng thay đổi nơi quyền kiểm soát nằm. Khi tác nhân chạy trên hạ tầng đám mây, an ninh phụ thuộc không chỉ vào bản thân tác nhân, mà còn vào kiểm soát truy cập và cách dữ liệu cùng quyền được quản lý trên nền tảng đó.

Ví dụ, người dùng có thể kết nối một tác nhân AI vào email, mong muốn nó chỉ đọc thư, trong khi cấu hình đám mây có thể cho phép nó gửi email trừ khi quyền đó được tắt rõ ràng.

Các tác nhân AI khác chatbot như ChatGPT như thế nào?

Chatbot như ChatGPT phản hồi, còn tác nhân AI hành động.

Một chatbot có thể đưa gợi ý hoặc giải thích. Một tác nhân AI có thể chủ động mở chương trình hoặc thực hiện quy trình công việc.

Ví dụ, một số người đã dùng OpenClaw để tự động hóa giao dịch. Họ đặt ra quy tắc và yêu cầu AI không chỉ đưa lời khuyên (ChatGPT có thể làm điều đó) mà còn thực sự thực hiện giao dịch.

Tại sao tác nhân AI lại tạo ra rủi ro bảo mật mới?

Như đã nêu, các tác nhân AI thực hiện hành động thay vì chỉ đưa lời khuyên. Điều này thường kèm theo quyền truy cập vào tệp, ứng dụng hoặc chức năng hệ thống.

Quyền truy cập hệ thống và mức độ tự chủ được cấp cho OpenClaw làm thay đổi cả tác động và rủi ro. OpenClaw sẽ yêu cầu quyền tương tác với phần mềm hoặc thực hiện hành động như gửi email hay điền form mà không có giám sát của bạn. Điều này biến nó thành một yếu tố khó lường.

Sai sót hoặc bị thao túng có thể gây hậu quả thực tế. Rủi ro không chỉ là những gì tác nhân được bảo làm, mà còn là những gì nó diễn giải thành hướng dẫn khi thực hiện nhiệm vụ.

Tại sao đầu vào không đáng tin cậy là vấn đề cốt lõi

Các tác nhân AI tiêu thụ lượng lớn nội dung bên ngoài (như trang web và tài liệu) để quyết định bước tiếp theo. Nội dung đó không phải lúc nào cũng đáng tin cậy.

Hướng dẫn không cần phải trực tiếp. Chúng có thể ẩn trong văn bản hoặc dữ liệu mà tác nhân đọc khi thực hiện nhiệm vụ. Điều này cho phép kẻ tấn công ảnh hưởng tới hành vi của tác nhân mà không cần tương tác trực tiếp với nó.

Vấn đề này tạo ra con đường rõ ràng dẫn tới chèn lệnh (prompt injection) — nơi đầu vào không đáng tin cậy được dùng để điều hướng tác nhân làm những hành động nó không được thiết kế để thực hiện.

Các công cụ AI mạnh cần được bảo vệ chặt chẽ hơn

Các tác nhân AI có thể truy cập tệp, email và chức năng hệ thống. Kaspersky Premium giúp phát hiện hoạt động đáng ngờ, chặn mã độc và bảo vệ thiết bị của bạn khỏi các mối đe dọa mạng trong đời thực.

Dùng thử Kaspersky Premium miễn phíChèn lệnh (prompt injection) trong tác nhân AI là gì?

Chèn lệnh là phương thức thao túng một tác nhân AI bằng cách cung cấp cho nó nội dung không đáng tin cậy, làm thay đổi cách nó hành xử.

Rủi ro không phải là một lỗi kỹ thuật trong mã. Vấn đề là tác nhân có thể coi đầu vào bên ngoài như tin nhắn hay bình luận là lệnh. Khi điều đó xảy ra, tác nhân có thể bị dẫn dắt để thực hiện những hành động nó không được định làm.

Cách chèn lệnh vận hành trong môi trường thực tế

Chèn lệnh có thể trực tiếp hoặc gián tiếp.

- Trực tiếp – kẻ tấn công cố ý chèn chỉ dẫn vào nội dung mà tác nhân sẽ đọc.

- Gián tiếp – tác nhân tiếp nhận chỉ dẫn ẩn hoặc không mong đợi từ một trang web hay tin nhắn mà nó xử lý trong công việc bình thường.

Vấn đề cốt lõi là hành vi. Tác nhân có thể làm theo những gì nó diễn giải là hướng dẫn, ngay cả khi hướng dẫn đó đến từ nguồn không đáng tin cậy. Không cần phải có lỗi phần mềm để điều này xảy ra.

Tại sao chèn lệnh nguy hiểm hơn với tác nhân AI so với chatbot

Các chỉ dẫn bị chèn thường ảnh hưởng tới phản hồi và lời khuyên mà chatbot đưa ra. Với tác nhân AI, chúng có thể ảnh hưởng tới hành động.

Nếu tác nhân có quyền truy cập tệp hoặc điều khiển hệ thống, các chỉ dẫn bị thao túng có thể dẫn tới thay đổi thực tế. Đó là lý do chèn lệnh tạo rủi ro lớn hơn với tác nhân — kỹ thuật tương tự có thể thay đổi đầu ra văn bản của chatbot nhưng khi áp dụng với tác nhân lại có thể kích hoạt hành động không mong muốn.

Bộ nhớ kéo dài (persistent memory) trong tác nhân AI là gì?

Bộ nhớ kéo dài cho phép tác nhân AI lưu giữ thông tin theo thời gian. Nó có nghĩa là tác nhân có thể dùng đầu vào trước đó để hướng dẫn quyết định trong tương lai thay vì bắt đầu lại từ đầu với mỗi nhiệm vụ.

Bộ nhớ kéo dài có ý nghĩa gì đối với tác nhân AI

Một tác nhân AI có thể lưu ngữ cảnh và chỉ dẫn qua nhiều phiên và phát triển ‘hành vi’ ưa thích. Điều này giúp tác nhân hoạt động hiệu quả hơn bằng cách nhớ những gì nó đã học hoặc đã làm trước đó.

Nó cũng có nghĩa là các đầu vào trước đây có thể ảnh hưởng tới hành vi sau này. Các chỉ dẫn hoặc giả định thu được trong nhiệm vụ trước đó có thể tiếp tục định hình cách tác nhân hành xử trong tình huống khác, ngay cả khi người dùng không còn nhận ra chúng.

Tại sao bộ nhớ kéo dài làm tăng rủi ro bảo mật

Bộ nhớ kéo dài có thể tạo ra hiệu ứng trì hoãn. Một chỉ dẫn có hại có thể không gây vấn đề ngay lập tức nhưng có thể xuất hiện trở lại sau này khi điều kiện phù hợp.

Điều này làm cho việc dọn dẹp khó khăn hơn. Hành vi đã lưu có thể lặp lại qua nhiều nhiệm vụ. Việc khôi phục hoàn toàn tác nhân thường đòi hỏi xóa bộ nhớ hoặc xây dựng lại cấu hình để đảm bảo loại bỏ ảnh hưởng không mong muốn.

Khi tác nhân AI bị cấu hình sai hoặc bị phơi bày thì chuyện gì xảy ra?

Một tác nhân AI có thể bị truy cập hoặc bị ảnh hưởng theo những cách mà chủ sở hữu không bao giờ chủ định, biến một công cụ hữu ích thành rủi ro bảo mật tiềm tàng.

Điều này có thể xảy ra do sơ suất hoặc hiểu nhầm. Nó cũng có thể xảy ra nếu bên thứ ba cố gắng thao túng tác nhân.

Các cách tác nhân AI có thể bị phơi bày vô tình

Sự phơi bày thường xảy ra qua những sai sót đơn giản. Một xác thực yếu hoặc quyền hạn quá rộng cũng có thể khiến tác nhân có thể truy cập được từ ngoài môi trường dự kiến.

Chạy tác nhân cục bộ không tự động khiến nó an toàn. Nếu nó kết nối Internet hoặc tương tác với hệ thống khác thì nó có thể bị ảnh hưởng. Kiểm soát cục bộ giảm bớt một số rủi ro nhưng không xóa chúng hoàn toàn.

Tại sao tác nhân AI bị phơi bày lại trở thành bề mặt tấn công

Khi đã bị phơi bày, tác nhân AI trở thành thứ mà kẻ tấn công có thể dò hỏi, thử nghiệm và thao túng. Họ có thể cố gắng cung cấp đầu vào được dàn dựng, kích hoạt hành động hoặc tìm hiểu cách nó hành behaves theo thời gian.

Bởi vì tác nhân có thể thực hiện hành động thực tế, lạm dụng không nhất thiết phải giống một cuộc tấn công mạng truyền thống. Việc lạm dụng có thể bao gồm điều hướng hành vi, trích xuất dữ liệu, hoặc gây ra thay đổi hệ thống không mong muốn, tất cả mà không cần khai thác lỗi phần mềm cổ điển.

Bộ ba gây hại trong an ninh tác nhân AI là gì?

Bộ ba gây hại mô tả ba điều kiện kết hợp với nhau tạo ra rủi ro an ninh nghiêm trọng cho tác nhân AI.

Ba điều kiện cho phép tấn công nghiêm trọng

- Điều kiện đầu tiên là truy cập vào dữ liệu nhạy cảm, chẳng hạn tệp, thông tin đăng nhập hoặc thông tin nội bộ.

- Điều kiện thứ hai là đầu vào không đáng tin cậy, tức tác nhân tiêu thụ nội dung mà nó không thể xác minh hoàn toàn.

- Điều kiện thứ ba là khả năng thực hiện hành động ra bên ngoài, như gửi yêu cầu, sửa đổi hệ thống hoặc chạy lệnh.

Riêng lẻ, những yếu tố này có thể được kiểm soát. Chúng trở nên nguy hiểm khi cùng tồn tại trong bộ ba này. Một tác nhân có thể đọc đầu vào không đáng tin cậy và hành động theo nó tạo ra con đường rõ ràng cho việc thao túng. Kiểm soát những hành động mà tác nhân được phép thực hiện là điều then chốt.

Người dùng hàng ngày có nên chạy tác nhân AI ngay hôm nay không?

Với hầu hết mọi người, tác nhân AI vẫn là công cụ thử nghiệm. Chúng có thể hữu ích trong thiết lập phù hợp. Mặt trái là gì? Chúng cũng mang theo những rủi ro mới mà không phải lúc nào cũng rõ ràng.

Khi nào dùng tác nhân AI là hợp lý

Tác nhân AI có thể hợp lý trong các kịch bản kiểm soát và rủi ro thấp. Điều này bao gồm thử nghiệm trên thiết bị riêng biệt. Một số người chạy tác nhân chỉ xử lý nhiệm vụ không nhạy cảm như sắp xếp tệp hoặc kiểm tra luồng công việc.

Giả sử bạn muốn tác nhân tạo lịch trình cho chuyến đi sắp tới. Nó có thể truy cập thông tin để làm việc này và được ngăn không cho liên hệ trực tiếp với người khác hoặc thực hiện hành động gây thiệt hại.

Nếu bạn thoải mái quản lý cài đặt và các sai sót không phải là vấn đề trọng đại thì tác nhân có thể là công cụ học tập. Chìa khóa là giữ phạm vi nhỏ và hạn chế quyền truy cập chặt chẽ.

Khi nào tác nhân AI là ý tưởng tồi

Tác nhân AI không phù hợp khi chúng có quyền truy cập dữ liệu nhạy cảm hoặc tài khoản quan trọng. Chạy tác nhân mà không hiểu quyền hạn hay nguy cơ từ đầu vào bên ngoài sẽ nhanh chóng làm tăng rủi ro.

Cũng hoàn toàn hợp lý khi không dùng. Quyết định không chạy tác nhân AI hiện tại là lựa chọn hợp lý nếu sự tiện lợi đi kèm với chi phí an ninh hoặc mất yên tâm.

Các biện pháp bảo vệ cơ bản nào là cần thiết khi sử dụng tác nhân AI?

Các biện pháp bảo vệ cơ bản giúp giảm rủi ro và ngăn sai sót trở thành vấn đề nghiêm trọng.

Phần mềm của Kaspersky có thể thêm một lớp bảo vệ bằng cách đánh dấu hành vi đáng ngờ và giúp bảo vệ tài khoản khỏi bị xâm nhập. Các gói của chúng tôi ngăn chặn mọi thứ từ phần mềm độc hại và virus, tới ransomware và ứng dụng gián điệp.

Biện pháp an toàn nào quan trọng nhất

Cô lập là then chốt. Hãy chạy tác nhân trên thiết bị và tài khoản riêng biệt khi có thể để chúng không ảnh hưởng đến dữ liệu hoặc hệ thống quan trọng. Hạn chế quyền chỉ ở mức tác nhân thực sự cần. Chúng tôi khuyến nghị tránh cấp quyền truy cập toàn hệ thống hoặc toàn tài khoản như mặc định.

Các bước phê duyệt cũng quan trọng. Yêu cầu xác nhận trước các hành động nhạy cảm tạo ra khoảng dừng giúp ngăn hành vi không mong muốn, như cam kết chi tiền thay bạn. Những kiểm soát đơn giản này có tác động lớn mà không làm tăng nhiều phức tạp.

Tác nhân AI có ý nghĩa gì đối với tương lai của AI dành cho người tiêu dùng?

Các tác nhân AI hướng tới một tương lai nơi công cụ AI làm nhiều hơn là hỗ trợ — chúng còn hành động. Nhưng chuyển đổi này đi kèm với đánh đổi mà người tiêu dùng mới bắt đầu định hướng.

Khoảnh khắc này cho chúng ta biết điều gì về độ trưởng thành của tác nhân AI

Các tác nhân AI mạnh nhưng còn non trẻ. Chúng có thể tự động hóa nhiệm vụ, nhưng vẫn gặp khó khăn với những yếu tố liên quan đến phán đoán và bảo mật. Điều này không có nghĩa là tác nhân sẽ không trở nên an toàn hơn hoặc đáng tin cậy hơn. Nó chỉ ra rằng kỳ vọng nên thực tế.

Các tác nhân AI cho thấy xu hướng tương lai, nhưng để được sử dụng rộng rãi hàng ngày sẽ cần biện pháp bảo vệ tốt hơn và công cụ được thiết kế với an toàn ngay từ đầu.

Bài viết liên quan:

- ChatGPT giải quyết các mối lo ngại về an ninh mạng và những rủi ro tiềm tàng như thế nào?

- Những rủi ro của tội phạm mạng sử dụng AI trong bối cảnh kỹ thuật số ngày nay là gì?

- Làm thế nào AI và Học máy cải thiện các biện pháp an ninh mạng?

- Nguy cơ của công nghệ Deepfake hiện nay là gì?

Sản phẩm đề xuất:

FAQs

OpenClaw có thể tải miễn phí không?

OpenClaw có thể được tải xuống miễn phí trên GitHub. Đây là phần mềm mã nguồn mở. Điều này có nghĩa là nhiều người có thể sửa đổi và phân phối lại phần mềm.

OpenClaw có dễ cài đặt không?

Có các hướng dẫn có thể giúp người dùng chạy bot nhanh chóng, nhưng một cấu hình tinh vi đòi hỏi thời gian và kiến thức chuyên môn. Do đó, việc chạy phần mềm có thể trở nên rủi ro nếu không được thiết lập đúng cách.